Большие языковые модели. Практическое применение

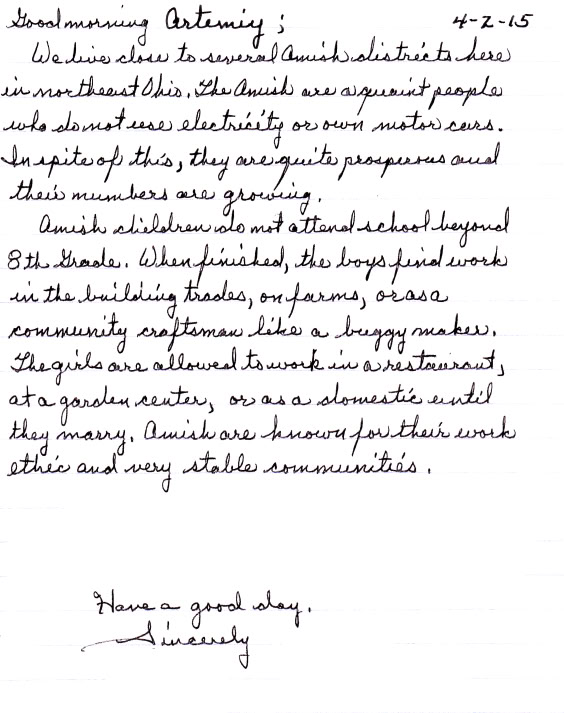

Какое-то время назад я увлекался посткроссингом. Однажды в конверте мне пришла открытка и к ней письмо. Оно написано красивейшим каллиграфическим почерком. Но была одна проблема: я не мог разобрать практически ни слова. Недавно я снова наткнулся на это письмо. Вот оно (я, конечно же, убрал все данные отправителя). Желающие могут попробовать расшифровать.

Но теперь ведь можно воспользоваться всеми благами цивилизации и попросить сделать эту работу большую языковую модель, также именуемую в широких массах ИИ. Через несколько секунд получаю текст:

Goodmorning Artemiy;

We live close to several Amish districts here in northeast Ohio. The Amish are a quaint people who do not use electricity or own motor cars. In spite of this, they are quite prosperous and their numbers are growing.

Amish children do not attend school beyond 8th Grade. When finished, the boys find work in the building trades, on farms, or as a community craftsman like a buggy maker. The girls are allowed to work in a restaurant, at a garden center, or as a domestic until they marry. Amish are known for their work ethic and very stable communities.

Have a good day.

Sincerely

Но ведь еще интереснее узнать, как именно это работает. О чем я и спросил модель. Это кстати Gemini. Вот подробное объяснение:

1. Этап «Зрения» (OCR — Optical Character Recognition)

Первым делом модель разбивает изображение на сегменты: строки, слова и отдельные символы. Она ищет знакомые паттерны. Например, в строке «The Ancich are aquaint people» модель видит визуальные контуры, которые напоминают буквы.

Однако на этом этапе часто возникают ошибки. В твоем тексте мы видим, как «Amish» превратилось в «Ancich», а «quaint» (необычный, старомодный) в «aquaint».2. Этап «Смыслового клея» (Контекст)

Это самая важная часть, где языковая модель (LLM) начинает доминировать над простым сканером. Модель анализирует вероятность появления слова в конкретном окружении:

Логическая коррекция: Если в тексте упоминается Огайо, отсутствие электричества и машин , вероятность того, что слово «Ancich» — это на самом деле «Amish» (амиши), возрастает до 99.9%.

Исправление грамматики: Фраза «sto mot rese electricity» для зрения выглядит именно так, но для языковой модели это не имеет смысла. Она «догадывается», что автор имел в виду «do not use electricity», потому что буквы s/d и m/n в курсиве часто пишутся почти идентично.3. Техника «Кросс-референса» (Проверка фактов)

Модель не просто читает, она сверяется с базой данных мира.За что «цепляться» человеку при разборе?

Если ты захочешь разобрать подобный текст сам, используй алгоритм модели:1. Выдели маркеры (Anchor words): Найди слова, которые написаны четко. В этом письме это «Cleveland», «electricity» и «8th Grade». Они задают тему.

2. Изучи манеру письма (Pattern matching): Посмотри, как автор пишет букву «s». В слове «prospectus» (вместо «prosperous») и «districts» она может выглядеть специфично. Поняв одну букву, ты «вскроешь» все остальные такие же буквы в тексте.

3. Иди от общего к частному: Сначала пойми общую тему (амиши, Огайо, деревня), и тогда непонятные слова вроде «slomestic» сами собой превратятся в «domestic» (домашняя прислуга), потому что это вписывается в описание гендерных ролей в общине.

Почерк действительно каллиграфичен, но его сложность — в «соединениях» букв. Он пишет связно, из-за чего «do not» превращается в «sto mot». Именно на таких стыках модель и проявляет свою «умность», восстанавливая смысл по цепочке.

Объяснение меня лично впечатлило не меньше, чем результат.